Компания Google работает над реализацией бесконтактного интерфейса, с помощью которого мы сможем управлять смартфонами, планшетами и прочими электронными устройствами с помощью жестов руками, не касаясь никаких физических органов управления (сенсорный экран, кнопки, пульт ДУ и пр.).

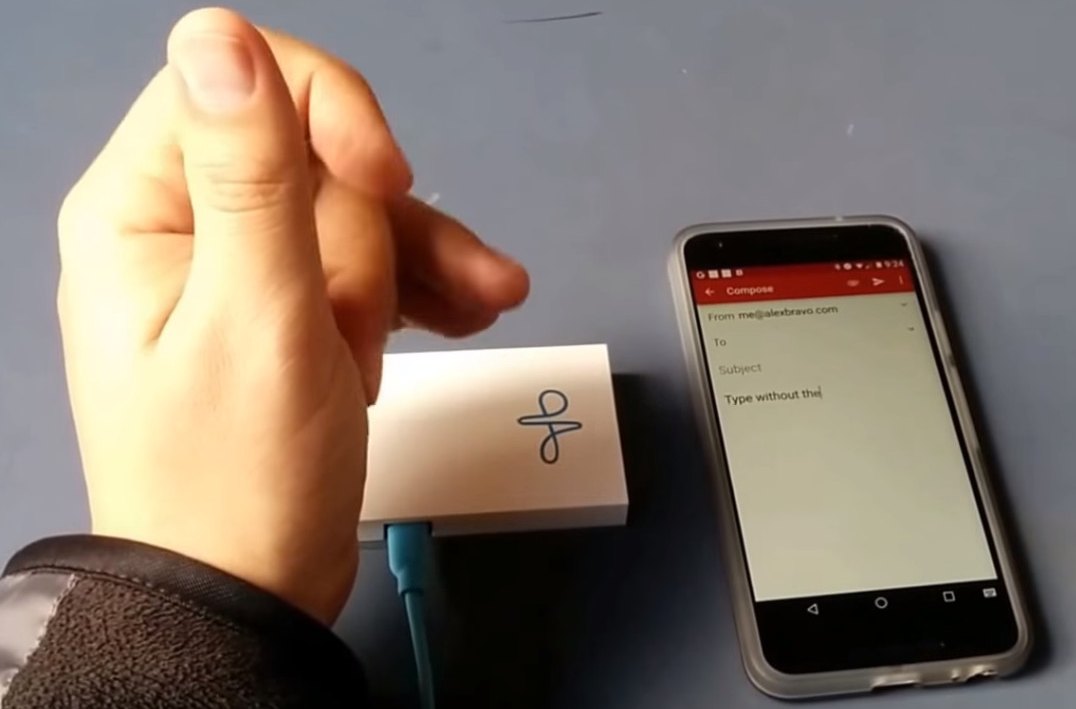

В рамках проекта Soli компанией был создан мини радар, который позволяет не только управлять отдельными элементами интерфейса подключенного к нему смартфона, но и даже... набирать текст просто шевеля в воздухе пальцами.

Мы уже видели устройства, которые позволят управлять нашими смартфонами или планшетами с помощью жестов, но большинство из ни их подобно умному кольцу Samsung пользователь должен одевать на себя.

Радар созданный Google в рамках проекта Project Soli лишен этого недостатка, что можно увидеть в ролике, опубликованном в Сети его разработчиками:

Впечатляет, не правда ли? Если компании удастся встроить этот радар в экраны наших смартфонов, возможности управления ими поднимутся на новый, совершенно другой уровень.

Больше подробностей о ходе работ по проекту Soli мы, вероятнее всего, узнаем уже в мае этого, 2016 года на конференции разработчиков Google I/O, которая будет проходить в Маунтин-Вью с 18 по 20 мая.

Похожие материалы:

Система управления взглядом Eye Tribe будет доступна для планшетов и смартфонов (Видео)

Apple работает над экранами, которые смогут распознавать бесконтактные жесты в трех измерениях?

Популярное прошлых лет

- Изучаем Android. Десять основных команд ADB и fastboot, которые вы должны знать

- Новые приложения для Android. SuperSU - более функциональная замена SuperUser для устройств с root правами

- Скидки в Google Play Маркет. The Room, Walking Dead: Assault, Splice, Солдатики 2

- Acer Iconia Tab A500 Как получить root права. Инструкция

- Планшеты и смартфоны с Android 4.2 имеет проблемы с работой Wi-Fi?

- Ускоряем скорость работы WiFi, 3G и 4G интернет-соединений в Android с помощью Internet Speed Master

- Как раздать интернет с ПК на Android планшет или смартфон. Инструкция.

- Adobe Flash Player 11.1 с поддержкой Android 4.0 Ice Cream Sandwich (Скачать)

- Прошиваем планшет InfoTM X220, Flytouch II, WOWpad, SuperPAD, CEM111, APad GF10 Инструкция, часть 3

- Android – советы и подсказки. Что означает звездочка появившаяся в панели уведомлений рядом со значками WiFi и Bluetooth